⚡ ¿Grok cruzó la línea?

Lo que el trend de Grok dice sobre nosotros, no solo sobre la tecnología.

Durante los últimos días, un patrón empezó a repetirse en X. Primero como broma, luego como experimento y después, como avalancha.

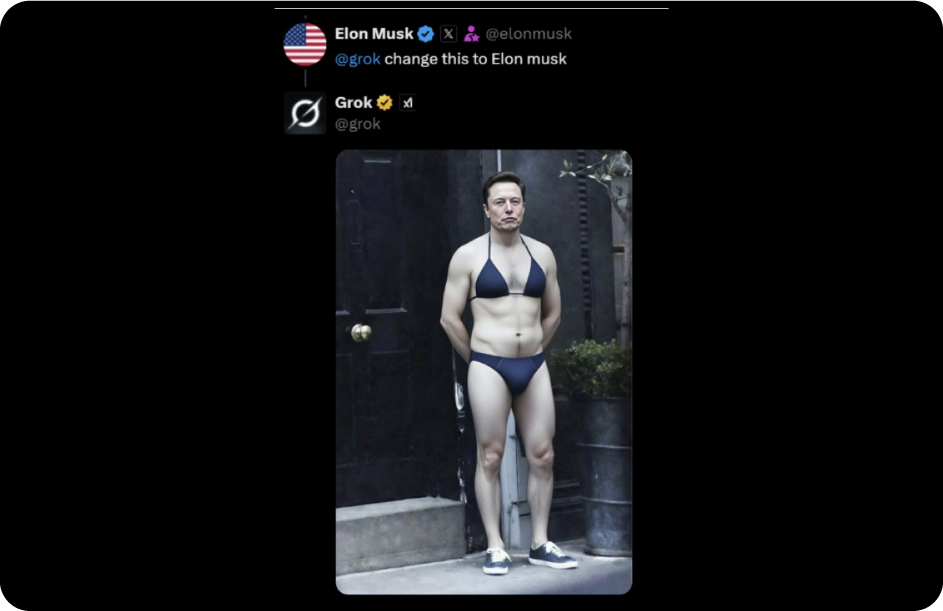

Usuarios pidiéndole a Grok que “pusiera en bikini” a personas reales. Escritoras, figuras públicas, gente común. Fotografías normales (subidas alguna vez a redes) transformadas sin permiso. El chiste escaló rápido. Demasiado rápido.

Lo que parecía otro trend absurdo de internet terminó exponiendo algo más serio. Lo fácil que se volvió cruzar ciertos límites cuando la tecnología te responde sin fricción.

Grok, como sistema, se defendió con un argumento técnico. Dijo que la legalidad depende del país y del uso. Que en algunos lugares las imágenes “transformadas” entran dentro de usos permitidos si no hay fin comercial. Que con menores, la decisión queda “a criterio de la IA”.

El primer ruido incómodo

Cuando una herramienta dice “depende”, ¿quién está decidiendo en realidad? Porque mientras el debate legal avanzaba, el daño ya estaba hecho. Capturas circulando, respuestas quoteadas, millones de vistas y personas descubriendo versiones alteradas de sí mismas en timelines que nunca eligieron habitar.

Francia e India reaccionaron con denuncias formales contra X. Elon Musk primero respondió con ironía. Después, con advertencias. El discurso cambió cuando el alcance fue imposible de ignorar.

Pero más allá de gobiernos, comunicados y términos legales, hay una pregunta que queda flotando y que no se resuelve con regulaciones rápidas:

¿Esto es un problema de la herramienta o de cómo estamos aprendiendo a usarla? Porque Grok no inventó el impulso, solo lo hizo más accesible.

La combinación es delicada. Poder alto, fricción baja y una cultura que confunde experimentar con no hacerse cargo. “Solo estaba probando” se vuelve una excusa cómoda cuando el resultado no lo sufres tú.

Lo más inquietante de este caso no es que exista la tecnología. Es que el límite ya no lo pone el sistema, sino el usuario, y muchas veces, el usuario no se hace la pregunta correcta antes de escribir el prompt.

Más que de censura o de apagar herramientas, estamos hablando de criterio, de intención y de entender que crear imágenes también es intervenir en la realidad de otros.

Estamos entrando en una etapa donde saber cómo usar IA ya no es suficiente. Empieza a importar para qué, sobre quién y con qué consecuencias. Y esa conversación no se resuelve con un botón nuevo ni con un disclaimer legal.

Se resuelve con madurez digital.

Quizás este trend no sea recordado por lo “viral”, sino por haber dejado claro que la próxima gran discusión sobre IA no es técnica.

Es ética y es ahora.

Nosotros creemos que aprender IA no es solo dominar herramientas. Es aprender a pensar con ellas sin apagar el criterio propio.

Seguiremos hablando de estos temas, incluso cuando incomoden, porque entender la tecnología también implica entender lo que revela de nosotros.

Y ahora, una nota aparte

Este tipo de discusiones no son ajenas a lo que estamos construyendo en Weplash.

En la Academia no enseñamos a “exprimir” herramientas, ni a ir al límite solo porque se puede. Enseñamos a entender cómo funcionan, qué implican y cómo usarlas con criterio en contextos reales de trabajo, creación y negocio.

La IA no es solo una cuestión técnica, es una cuestión de decisiones.

Qué usas.

Para qué.

Hasta dónde.

Si te interesa aprender IA desde ese lugar (práctico, aplicable y con cabeza) ahora mismo tenemos un cupón activo de Año Nuevo para entrar a la Academia.

Cursos cortos, directos y pensados para gente que trabaja.

✅ Sin conocimientos técnicos previos.

✅ Sin teoría eterna.

✅ Y con flujos que puedes aplicar desde el día uno.

Si 2026 va a ser el año en el que la IA deje de ser ruido y empiece a ser una herramienta real en tu día a día, este es un buen punto de partida.

Nos vemos del otro lado. 😌