⚡️ ¿Por qué todos se están cambiando a Claude?

Seguridad, contratos con defensa y el momento en que los modelos dejaron de ser “apps”

Hay un tema dando vueltas que suena a thriller, pero en el fondo es una pregunta bien práctica.

¿Hasta dónde llega un modelo cuando deja de ser una herramienta de productividad y entra a jugar en el terreno de gobierno, seguridad y guerra?

En los últimos días se cruzaron tres cosas: Anthropic y su postura con Claude, el gobierno de USA empujando por acceso más amplio y OpenAI firmando un acuerdo para operar en entornos clasificados. El resultado es confusión, polarización y una migración real de usuarios que están reevaluando qué IA es más segura para trabajar.

Vamos por partes.

la reintroducción de Claude

Claude es el modelo de Anthropic.

Mucha gente lo viene usando porque se siente más ordenado para trabajar con texto largo, contexto, proyectos y tareas de análisis. Esa preferencia se volvió más visible cuando empezaron a aparecer flujos tipo “coworker” (proyectos, documentos, iteraciones) y menos “chat de una sola vez”.

Hasta aquí, todo normal.

Sin embargo, a partir de ahí, la conversación se mueve hacia otra pregunta: qué usos acepta cada modelo y qué límites pone.

el conflicto de fondo no es técnico

Para entender por qué esto explotó, ayuda pensar en el contexto en el que se mueve el gobierno de USA hoy.

El Departamento de Defensa y otras áreas del Estado llevan meses empujando para incorporar modelos en trabajo operativo: análisis, planificación, síntesis de información, soporte a decisiones y automatización de tareas internas. Eso requiere acceso a modelos que puedan correr en entornos controlados, con reglas claras sobre permisos, datos sensibles y límites de uso.

En paralelo, las empresas que entrenan modelos han ido construyendo políticas y barreras de seguridad propias. Esas barreras no siempre calzan con lo que un comprador institucional quiere, sobre todo cuando el cliente está pensando en escenarios extremos y pide flexibilidad para adaptar la herramienta a muchas situaciones.

En el caso de Anthropic, el choque se concentró en temas que tienden a aparecer cada vez que un modelo se acerca a gobierno y seguridad.

Aquí vale sumar un dato que le dio forma pública a la discusión. Dario Amodei, CEO de Anthropic, habló en una entrevista reciente sobre por qué su empresa insiste en dejar ciertas restricciones por escrito. Su punto central fue de privacidad: con IA, armar perfiles completos de personas a partir de datos dispersos se vuelve demasiado fácil y demasiado escalable.

Y por eso le preocupa que ese tipo de capacidad termine habilitando vigilancia masiva doméstica. También mencionó límites alrededor de decisiones letales sin supervisión humana.

Lo importante aquí es qué límites quedan escritos en la política del modelo, cuáles quedan como condiciones de despliegue, quién autoriza excepciones y qué pasa cuando una institución pide remover o suavizar restricciones.

Por eso este caso se volvió una conversación pública. Expuso cómo se negocia el uso real cuando hay riesgo, responsabilidad y reputación en juego.

¿por qué aparece OpenAI en esta historia?

En paralelo, OpenAI anunció un acuerdo con el Departamento de Defensa para desplegar sus modelos en entornos clasificados.

OpenAI lo presentó como un acuerdo con “capas” de seguridad y límites explícitos, incluyendo despliegue en nube, personal en el loop y red lines sobre vigilancia doméstica y armas autónomas.

El debate se calentó por un matiz que siempre pesa en contratos de este tipo: el lenguaje.

Frases como “para cualquier uso legal” suenan tranquilizadoras, pero dependen de cómo se define y se aplica “legal” en prácticas reales de inteligencia y seguridad. Por eso aparecieron lecturas críticas señalando que el margen práctico puede sentirse más amplio de lo que la gente asume.

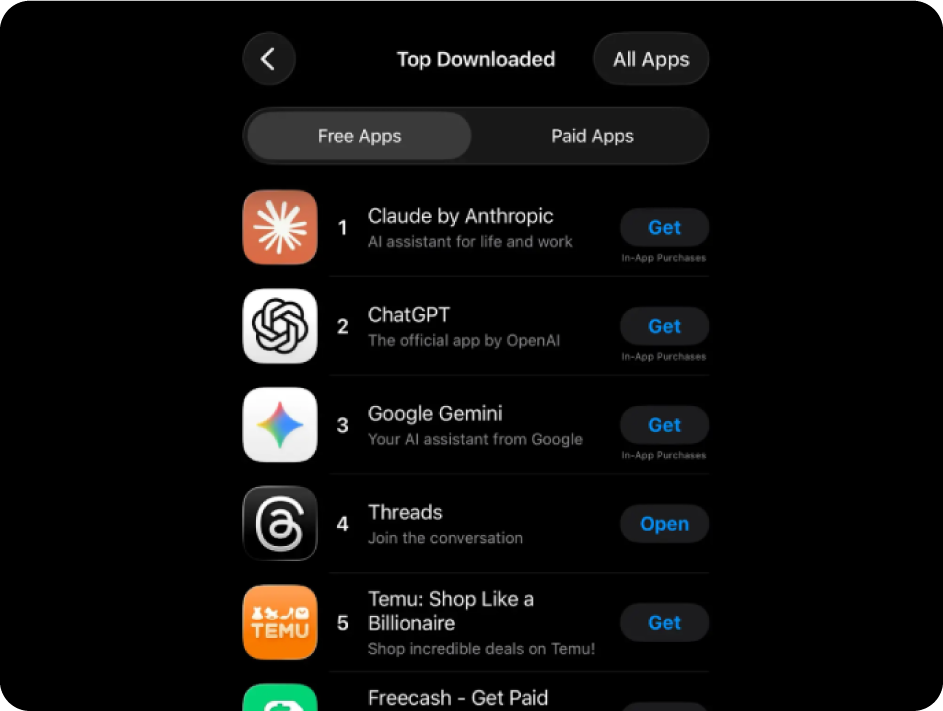

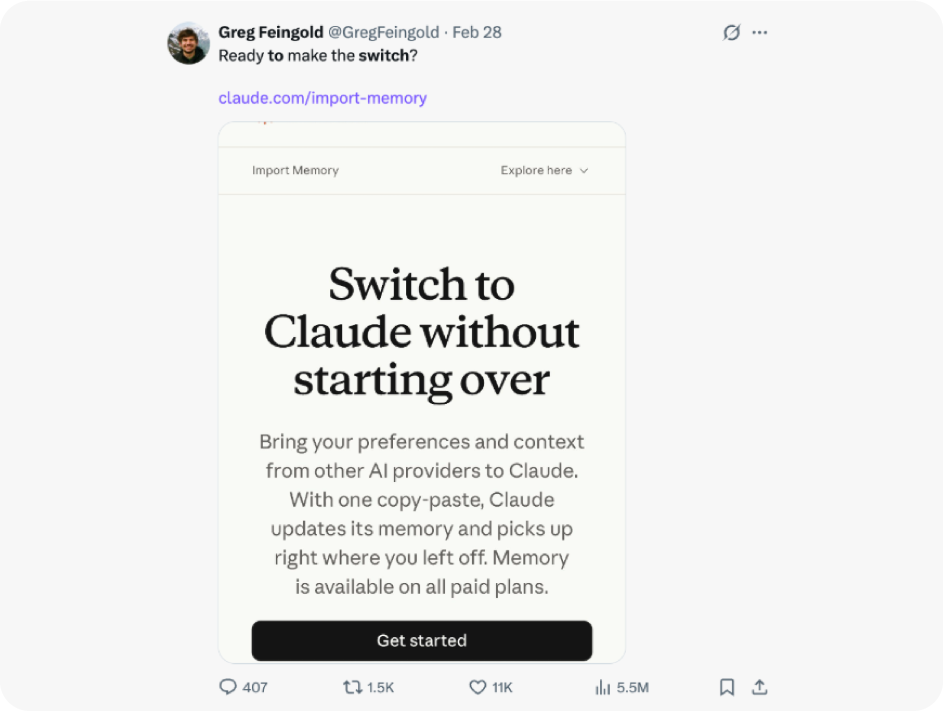

En paralelo, el público empezó a ordenar la historia en categorías morales, y ahí aparece el efecto visible en el público. En estos días Claude subió al puesto #1 en el App Store de USA y se llenó X de capturas de gente cambiándose.

Parte es apoyo genuino a la postura de Anthropic, parte es reacción al ciclo de noticias y parte es curiosidad colectiva.

Ese pico no prueba que el mercado ya se reordenó para siempre. Sí muestra algo importante: cuando la conversación toca privacidad, guerra y contratos con defensa, el producto deja de ser solo “cuál me responde mejor” y empieza a parecer una elección de confianza.

el detalle que casi nadie está mirando

Cuando un modelo empieza a operar en entornos clasificados y se integra a infraestructura de defensa, entra a otra clase de relación con el Estado y con el mercado. Empieza a funcionar como proveedor estratégico.

Eso trae tres consecuencias bien concretas:

Los límites dejan de ser “reglas de la app”. Empiezan a escribirse en acuerdos formales: qué se permite, qué se prohíbe y qué se revisa.

Una vez que se integra, cuesta sacarlo. Cuando un modelo entra a procesos, equipos y sistemas, ya no basta con “apagarlo”. Cambiarlo implica migraciones, permisos, capacitación y volver a probar todo.

La competencia se define por confianza operativa. Importa quién puede desplegar, controlar y sostener el modelo en situaciones sensibles sin generar problemas legales, de seguridad o de reputación.

En otras palabras, el mercado empieza a premiar tanto el modelo como la forma en que se despliega, se controla y se sostiene en escenarios sensibles.

¿qué significa esto para ti?

Este caso suena lejano hasta que lo llevas a tu día a día. En cuanto un modelo se conecta a datos internos, herramientas y flujos con permisos, aparecen las mismas preguntas que hoy se están discutiendo a escala gobierno.

Qué puede ver.

Qué puede ejecutar.

Qué queda registrado.

Qué se bloquea.

Qué pasa cuando falla.

Por eso esta conversación ya incluye otras capas además de “me gustó cómo escribe”. Entra en temas de confiabilidad, gobernanza y riesgo cuando un sistema tiene consecuencias reales.

Ese cambio de enfoque explica por qué tanta gente está reconsiderando qué modelo usa para trabajar.

en la academia de IA de Weplash

Si te interesa entender estos cambios sin perderte en el ruido, en la Academia los aterrizamos con calma.

Todas las semanas probamos herramientas nuevas, las llevamos a flujos reales y te dejamos el paso a paso listo para aplicar sin background técnico, sin programación y sin perder horas en teoría.

Además, los cursos incluyen certificaciones para tu CV y LinkedIn. Y en los retos puedes ganar dinero por aprender.

Esta semana vamos a hacer un live para desmenuzar lo más relevante de este tema con ejemplos claros.

No te lo pierdas, es este jueves 5 de marzo, 10:30 AM (GMT-05).

Nos vemos dentro. ✌🏻