⚡️ Manus ahora puede usar tu computadora - IA Simplificada

IA diseñando vacunas, robots aprendiendo de Pokémon Go y Nvidia preparando la era de la inferencia.

Manus acaba de salir de la nube y entrar directo a tu computadora. Ahora puede acceder a tus archivos, usar tus herramientas y ejecutar tareas en tu propio entorno local.

También hubo otras señales interesantes esta semana. Robots entrenados con datos de Pokémon Go, memoria visual para wearables, avances fuertes de Nvidia y tensiones legales en video con IA.

Esto es lo más importante.

Índice

Manus ahora puede usar tu computadora.

Una vacuna contra el cáncer creada con IA.

Pokémon Go ahora guía robots reales.

Memoria visual para wearables y robots.

Nvidia va con todo por la era de la inferencia.

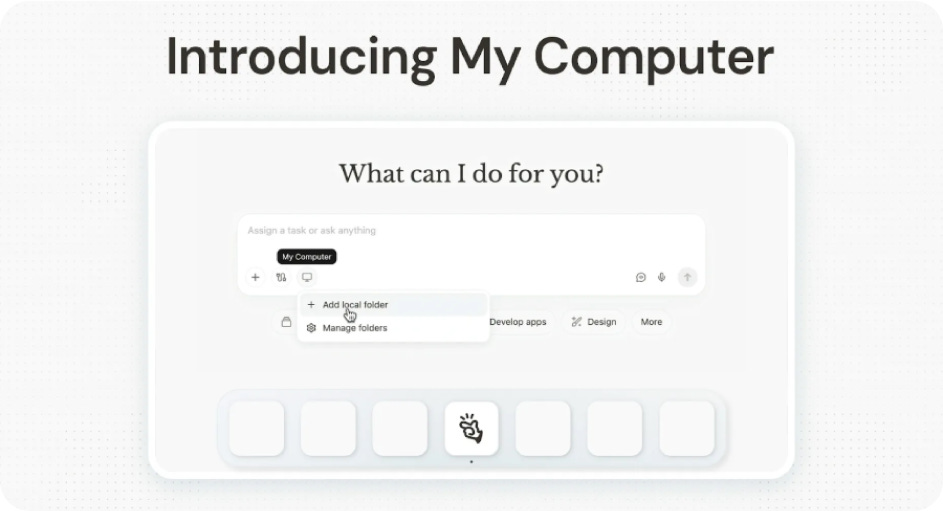

Manus ahora puede usar tu computadora

Hasta ahora, Manus vivía en la nube.

Eso le permitía navegar, ejecutar tareas y trabajar con información online, pero había una limitación clara: no podía tocar lo que realmente usas todos los días en tu máquina. Con la nueva función “Mi Computadora”, eso cambia.

Ahora Manus puede ejecutar comandos en tu terminal, acceder a archivos locales, organizar carpetas, editar documentos y hasta controlar aplicaciones directamente desde tu computadora.

En la práctica, esto abre casos muy concretos. Desde ordenar miles de archivos automáticamente hasta renombrar documentos, generar reportes o incluso crear apps completas usando herramientas como Python o Swift sin que tú tengas que hacerlo manualmente.

También puede usar el poder de tu propia máquina. Si tienes una GPU o un equipo encendido, Manus puede ejecutar tareas ahí, incluso mientras tú no estás.

¿Por qué importa?

Los agentes de IA empiezan a moverse del chat a la ejecución real. Cuando pueden trabajar directamente en tu entorno, dejan de ser solo asistentes y pasan a convertirse en sistemas que hacen trabajo por ti.

Una vacuna contra el cáncer creada con IA

Un emprendedor australiano ayudó a crear lo que podría ser la primera vacuna personalizada contra el cáncer para un perro.

Todo empezó cuando su mascota Rosie fue diagnosticada con cáncer. Después de cirugía y quimioterapia, los tumores seguían creciendo, así que decidió explorar otras opciones.

Usó ChatGPT para investigar inmunoterapia y terminó colaborando con científicos de la Universidad de Nueva Gales del Sur. Analizaron el ADN del tumor del perro y usaron herramientas como AlphaFold para identificar proteínas mutadas que podían convertirse en objetivos terapéuticos.

Con esa información desarrollaron una vacuna mRNA personalizada en menos de dos meses.

Rosie recibió la primera dosis en diciembre. Hoy varios de sus tumores se han reducido y su estado general mejoró lo suficiente como para volver a correr en el parque.

¿Por qué importa?

Este caso muestra cómo la IA ya está entrando en tratamientos médicos personalizados de forma muy concreta. También funciona como una prueba temprana para enfoques que más adelante podrían adaptarse a medicina humana.

Pokémon Go ahora guía robots reales

Durante casi una década millones de personas caminaron por ciudades capturando Pokémon con la cámara de su celular.

Lo que parecía solo un juego terminó generando uno de los datasets visuales más grandes del mundo.

Niantic, la empresa detrás de Pokémon Go, usó esas interacciones para construir una base de datos con más de 30 mil millones de imágenes del mundo real. Con ese material entrenaron un sistema de IA llamado Visual Positioning System (VPS) dentro de su división Niantic Spatial.

Este sistema compara lo que ve una cámara en tiempo real con ese mapa visual masivo y puede ubicar un dispositivo con precisión de centímetros, incluso en ciudades donde el GPS falla por los edificios.

La empresa de robótica Coco Robotics ya está usando este sistema para que sus robots de reparto puedan orientarse en calles y aceras mientras entregan comida y compras.

¿Por qué importa?

Para que robots, gafas inteligentes o vehículos autónomos funcionen bien, necesitan entender el mundo físico con mucha precisión. Ese tipo de percepción se entrena con datasets enormes del mundo real.

Este caso también abre una pregunta interesante. Muchas de esas imágenes fueron capturadas por jugadores que probablemente nunca imaginaron que terminarían entrenando sistemas de IA para robótica.

Desde un punto de vista legal, el uso suele estar cubierto por los términos de servicio de las apps. Desde el punto de vista ético, vuelve a aparecer el debate sobre datos generados por usuarios que luego alimentan modelos de IA comerciales.

Memoria visual para wearables y robots

La startup Memories.ai está construyendo una capa de memoria visual para wearables y robots.

La idea es que estos sistemas puedan ver lo que ocurre frente a ellos, recordarlo y recuperarlo después. Para hacerlo, la empresa está desarrollando infraestructura que permite almacenar y buscar escenas del mundo real capturadas con cámaras.

El proyecto nació después de que sus fundadores trabajaran en el sistema de IA detrás de las gafas Ray-Ban de Meta y vieran una limitación clara. Grabar video no sirve de mucho si luego el sistema no puede recordar qué vio ni encontrarlo cuando hace falta.

¿Por qué importa?

La memoria en IA también se está moviendo hacia imágenes y video. Para wearables, robots y sistemas físicos, recordar escenas, objetos y momentos del mundo real puede convertirse en una capa clave de utilidad.

Nvidia va con todo por la era de la inferencia

En su keynote de GTC, Jensen Huang dejó claro por dónde viene la siguiente gran ola. Nvidia ya ve hasta 1 trillón de dólares en pedidos comprometidos para Blackwell y Vera Rubin hasta 2027, el doble de lo que proyectaba antes.

La estrella fue Vera Rubin, la plataforma que sigue a Blackwell. Llega con nueva CPU Vera y GPUs optimizadas para inferencia masiva, con mejoras fuertes en rendimiento por watt y velocidad para procesar tokens a escala. El primer sistema ya está corriendo en Azure y los envíos grandes arrancan a finales de 2026.

También presentaron NemoClaw, un stack enterprise open source construido sobre OpenClaw para desplegar agentes de IA con más seguridad, privacidad y control dentro de empresas. Huang lo planteó como una nueva capa de infraestructura para sistemas agentic.

Bonus sci-fi: Nvidia también mostró Space-1 Vera Rubin, una idea de módulos de IA para data centers en órbita. La promesa es llevar muchísimo más cómputo fuera de la Tierra, aunque el gran reto sigue siendo cómo enfriar esos sistemas con radiación en el espacio. Si esto avanza, parte del futuro de la inferencia podría terminar literalmente fuera del planeta.

¿Por qué importa?

Nvidia está armando una infraestructura más amplia para un mundo donde la inferencia mueve cada vez más valor. Eso incluye chips, software, agentes, robótica y centros de datos. Cuando todo eso se conecta, la IA empieza a sentirse como una capa operativa de la economía digital.

⚡️ Bits express

ByteDance pausó Seedance 2.0. Su generador de video con IA se volvió viral en China con clips como una pelea entre Tom Cruise y Brad Pitt, pero la presión legal de estudios como Disney frenó el lanzamiento global mientras la empresa refuerza controles de propiedad intelectual.

Meta firmó un contrato gigante de infraestructura IA. La empresa acordó pagar hasta 27 mil millones de dólares a Nebius por capacidad en data centers durante los próximos cinco años.

OpenAI retrasó su modo adulto. Asesores internos alertaron sobre riesgos psicológicos y posibles errores del sistema que podrían clasificar menores como adultos.

Un diccionario demandó a OpenAI. Encyclopedia Britannica y Merriam-Webster acusan a la empresa de usar artículos protegidos por copyright para entrenar sus modelos.

xAI se está reorganizando internamente mientras intenta alcanzar a OpenAI y Anthropic en el mercado de asistentes de programación.

📍 Si estás en Madrid

Te cuento algo. El 24 de marzo, el podcast Marketing Sin Filtro, donde está nuestra CMO Marjori, va a grabar su episodio 100 en vivo.

Después de la grabación viene un taller práctico sobre cómo usan agentes de Claude y Manus en trabajo real. Vas a poder construir algo en vivo junto con las hosts.

Va a ser una tarde para aprender, ver flujos en acción y llevarte ideas útiles de verdad. Si estás en Madrid, puedes reservar tu entrada aquí.

Y si estás en el resto del mundo, todavía tienes chance de entrar al nuevo reto de la academia y ponerte al día antes de la próxima clase del jueves.

Vamos a trabajar una de las funciones más potentes de Claude, Skills, para que construyas automatizaciones útiles y conviertas a Claude en una herramienta que realmente te ayude a ejecutar trabajo.

No necesitas saber programar. Trabajamos con lenguaje natural, ejemplos claros y sesiones en vivo. El reto incluye certificación para tu CV y LinkedIn y $500 para las skills más votadas.

Entrar con $30 OFF en tu primer ciclo usando el cupón RETOCOWORK por pocos días. 🚀

Nos vemos del otro lado. ✌🏻