⚡️ Los highlights del Google I/O 2025

Todo lo que no viste (y deberías) del Google I/O 2025.

Si no seguiste el evento, tranqui. Acá te contamos lo esencial: lo que de verdad importa, lo que puedes usar, y por qué Google está corriendo a la par (o tratando) con Microsoft, OpenAI y Meta.

1. Gemini 2.5: el nuevo motor que mueve todo

Google presentó Gemini 2.5, su modelo más avanzado hasta ahora. Tiene dos versiones:

Gemini 2.5 Flash, optimizado para tareas rápidas (22% más eficiente).

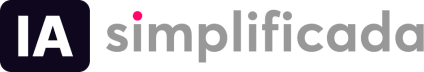

Gemini 2.5 Pro, con nuevas capacidades de razonamiento avanzado gracias a Deep Think, un modo que utiliza pensamiento en paralelo para resolver tareas complejas, como programación y matemáticas a nivel alto.

Además, el modelo ahora incluye generación de audio nativa y uso directo del computador (lo que abre la puerta a agentes AI aún más autónomos).

Pero lo más importante es que Gemini 2.5 ya no vive solo en una app. Está integrado en Gmail, Search, Docs, Meet, Android, Vids, Flow, y más.

La apuesta de Google no es que entres a usar su AI, sino que ya estés usándola sin darte cuenta, porque vive dentro de todo lo que ya haces.

2. Google Search cambia para siempre

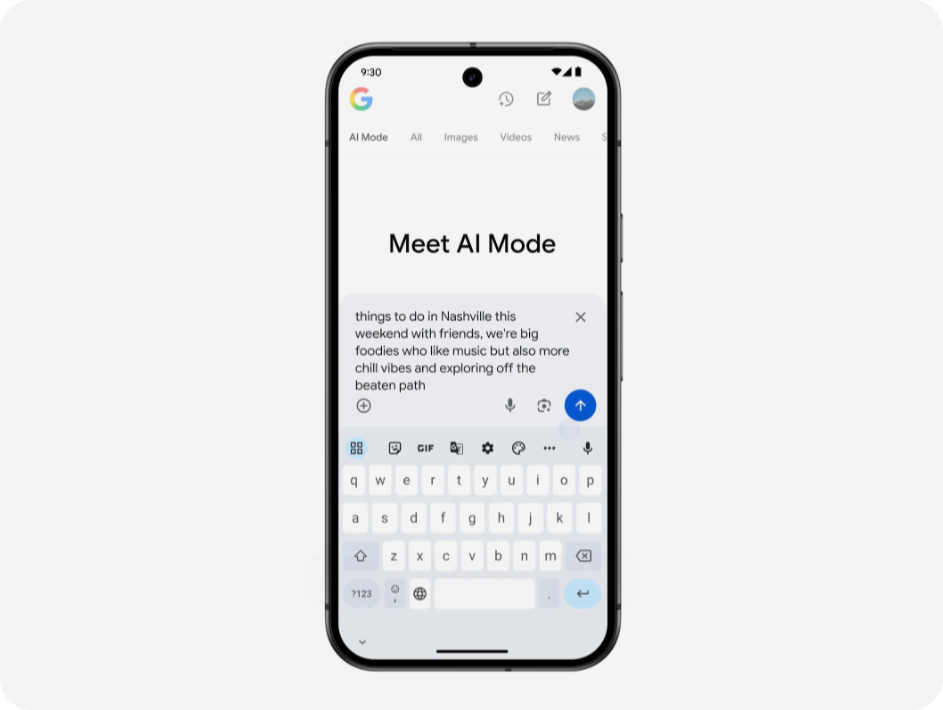

El clásico buscador ahora tiene AI Mode, que transforma por completo cómo buscas:

Puedes hacer preguntas largas y complejas, recibir respuestas sintetizadas con fuentes claras y usar Deep Search, que descompone tus consultas para darte información más profunda y relevante.

También puedes comparar productos, hacer investigaciones, analizar datos y ahora incluso buscar ropa, probarla con tu foto y hasta pedirle que la compre por ti (Buy for me). Todo desde una misma conversación.

Con el tiempo, estas funciones también llegarán a AI Overviews (los resúmenes que aparecen arriba de los resultados).

La búsqueda se vuelve conversacional, visual, personalizada y mucho más útil.

3. Project Astra quiere ser el asistente que no tienes que invocar

Es el prototipo de asistente AI de Google que observa, escucha y actúa sin que se lo pidas.

¿Dejaste los lentes en la cocina? Astra los vio. ¿Algo relevante ocurre en tu entorno? Puede comentarlo o ayudarte en tiempo real (no hablemos de privacidad 😅)

No está disponible aún, pero marca el futuro de los asistentes proactivos.

4. Gemini ahora tiene “Agent Mode”

Podrás pedirle una tarea a la AI y se encargará sola de hacerla. Desde buscar departamentos con filtros hasta gestionar varias acciones al mismo tiempo con Project Mariner (el motor detrás de esta automatización).

Google entra de lleno en la batalla de los agentes inteligentes, igual que Microsoft y OpenAI.

5. Habla con Gemini live

Con Live Search, apuntas tu cámara a lo que sea (ingredientes, objetos, lugares) y le preguntas qué ve.

Y también puedes compartir tu pantalla para que la AI te ayude con lo que tengas abierto. Como si le mostraras la compu a alguien que te entiende en serio.

6. Stitch: diseña interfaces con solo texto e imágenes

Es una nueva herramienta que convierte bocetos o prompts en diseños UI listos para exportar (con código incluido).

Ideal para desarrolladores y diseñadores que quieren acelerar procesos y probar variaciones rápido.

7. Lo nuevo en Video

Google lanzó la nueva versión de su generador de video, Veo 3, ahora con audio. Puedes agregar diálogos entre personajes, efectos y sonido ambiente.

El contenido generado por AI ya no es solo visual: ahora también se escucha.

Y también lanzan Flow: una nueva herramienta de video AI de Google.

Crea clips a partir de prompts, construir escenas completas y guardar todos los elementos que usaste (guiones, assets, estilos). Está diseñada especialmente para trabajar con sus modelos más potentes: Veo, Imagen y Gemini.

Un espacio para creadores que quieren generar contenido visual desde cero, sin salir del ecosistema Google.

8. Gmail, Docs y Vids ahora sí entienden lo que haces

Gemini se integra en serio a las herramientas que usas todos los días.

En Gmail, ahora puedes responder con sugerencias que entienden tu tono, tu contexto y hasta sacan info de tu Drive para evitarte tener que buscarla tú. Incluso puedes decirle que limpie tu bandeja con comandos como “borra todos los correos sin leer de tal marca” y lo hace.

En Google Docs, puedes vincular fuentes específicas (presentaciones, reportes, spreadsheets) y Gemini solo usará esa información para ayudarte a escribir, manteniéndose dentro del contexto correcto.

Y en Google Vids, las presentaciones ahora se transforman en videos con guion, voz generada, animaciones… y hasta avatares que presentan por ti. También sumaron mejoras como edición automática de audio y limpieza de muletillas (“ehh”, “umm”).

9. Imágenes AI que se ven (y se escriben) bien

Google presentó su nuevo modelo de generación de imágenes, Imagen 4.

Tiene mayor claridad en los detalles, funciona tanto para estilos realistas como abstractos, y puede generar imágenes en hasta 2K y en diferentes formatos.

¿Lo mejor? Finalmente, aprendió a escribir bien en las imágenes: mejor tipografía, mejor ortografía.

10. Google Meet ahora traduce en tiempo real (y suena como tú)

Meet estrenó traducción automática en vivo con Gemini: puedes hablar en tu idioma y la AI lo traduce al idioma de tu interlocutor manteniendo tu voz, tono y expresión.

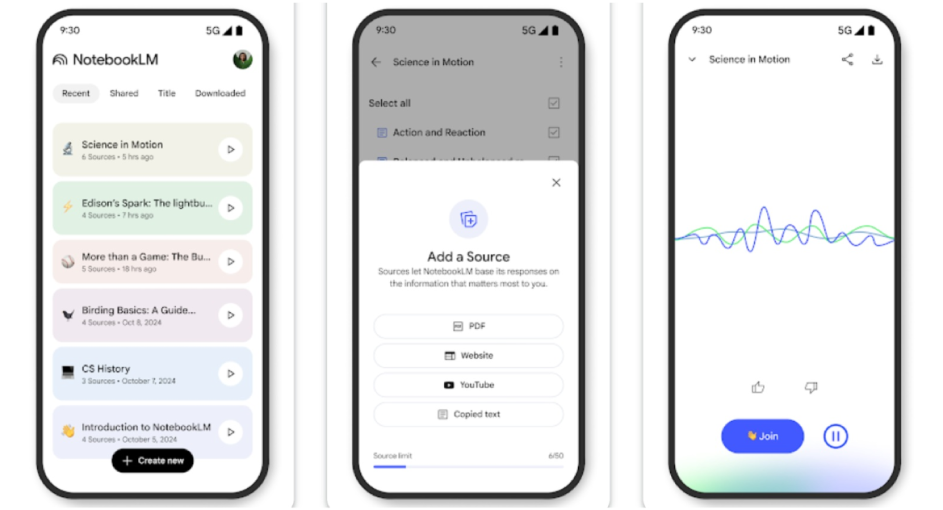

11. NotebookLM tiene app

Disponible en Android e iOS, ahora puedes pedirle que resuma, que te explique tus documentos, y que cree podcasts automáticos desde tus textos (Audio Overviews).

Pronto también podrás generar resúmenes en video desde PDFs o fotos.

Tu asistente de estudio, contenido o trabajo ya en tu bolsillo.

12. Google vuelve a apostar por los smart glasses (y va por Meta)

Junto a Xreal, presentaron Project Aura: unas gafas inteligentes con Gemini integrado y soporte para Android XR.

Lucen como lentes de sol normales, pero con cámaras, micrófonos y una pantalla inmersiva.

Serán la competencia directa de las Ray-Ban Meta, pero con todo el ecosistema de Google detrás.

¿Qué significa todo esto?

Google dejó claro que no quiere quedarse atrás en la carrera AI. Muchos de estos lanzamientos compiten directamente con las movidas de Microsoft, OpenAI, Perplexity y Meta.

Lo más potente del I/O no es la cantidad de funciones nuevas, sino cómo Google las distribuye donde ya vivimos: en Gmail, en Chrome, en el buscador, en nuestros archivos.

Su mayor ventaja no es solo la tecnología, sino un ecosistema que ya forma parte de nuestra rutina.

Más que prometer el futuro, Google lo está integrando en lo cotidiano, sin que tengas que cambiar de plataforma ni aprender algo desde cero.

Estás al día. Nos vemos mañana. 😎

La pelea es peleando! Wow, Google no podía quedarse atrás. Quién se acuerda de Bard? Nadie 😂