⚡️ La Navidad con IA de McDonald’s - IA Simplificada

Publicidad con IA, lentes inteligentes y quién realmente las está aprovechando.

McDonald’s encendió la conversación global con un anuncio navideño creado casi por completo con IA. Mientras tanto, Google acelera el futuro con gafas inteligentes, OpenAI publica datos reveladores sobre cómo usamos la IA en el trabajo y ZTE se atreve con el primer smartphone realmente pensado para agentes.

Vamos al resumen. ✨

Índice

McDonald’s y la Navidad hecha con IA.

Google presenta sus gafas inteligentes.

OpenAI revela cómo usamos la IA.

El primer smartphone de IA.

McDonald’s y la Navidad hecha con IA

McDonald’s lanzó un anuncio navideño producido con IA generativa. Casi todo el spot fue creado con modelos, desde escenas completas hasta personajes, supervisado por un equipo pequeño y workflows nuevos de producción.

El resultado dividió a internet. Muchos aplaudieron la estética y el mensaje; otros criticaron la “sensación artificial” en algunas tomas. Aun así, la marca dejó clara su postura: la IA ya forma parte del proceso creativo masivo.

La frase oficial lo resume: “La IA no hizo este film. Lo hicimos nosotros”. La herramienta fue parte del pipeline, no la protagonista.

¿Por qué es relevante?

Porque las marcas ya están usando IA a escala real, con resultados que se acercan cada vez más a un producto publicable sin postproducción pesada. Esto acelera tiempos, baja costos y abre el estándar de lo que se puede hacer en semanas… o días. La competencia va a sentirse fuerte en 2026.

El round 2 de las gafas inteligentes de Google

Google mostró un prototipo funcional de unas gafas con interfaz multimodal impulsada por Gemini.

Reconocen objetos, traducen texto en tiempo real, guían procesos físicos y pueden ejecutar tareas en conversación continua.

A diferencia de intentos pasados, estas lentes están diseñadas para integrarse a un ecosistema completo: Google Search, Assistant y Gemini 3.

¿Por qué es relevante?

Porque Meta ya probó con sus gafas que un wearable de IA puede ser útil en el día a día, pero Google llega con algo distinto: une esas capacidades con todo lo que ya sabe de tu comportamiento digital (Search, Maps, Gmail, Chrome, Gemini). Eso significa gafas mucho más integradas a cómo te mueves, trabajas y decides, no solo un gadget, sino una extensión directa de tu vida online.

Cómo se usa realmente la IA en el trabajo

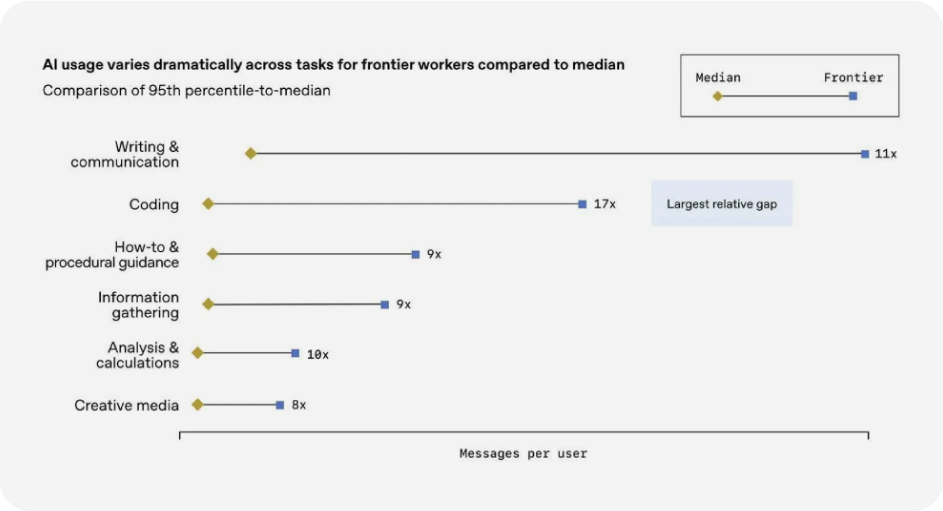

OpenAI publicó su reporte anual con datos interesantes. Solo una minoría de usuarios usa la IA como parte estructural de su trabajo. La mayoría consume respuestas rápidas; una minoría crea flujos avanzados, documentos complejos y decisiones automatizadas.

La brecha entre “usuarios casuales” y “usuarios potentes” se está volviendo enorme y eso determinará productividad, salarios y oportunidades.

¿Por qué es relevante?

Porque muestra que la ventaja competitiva no vendrá de “probar herramientas”, sino de convertir la IA en parte real del proceso. Quien automatiza tareas, sintetiza información y construye agentes ya juega en otra liga.

El primer smartphone realmente diseñado para agentes

ZTE presentó un teléfono construido para operar agentes IA como parte del sistema operativo. Incluye un “modo agente” que permite delegar tareas completas: monitorear bandejas de entrada, buscar información, coordinar actividades o ejecutar flujos predefinidos.

Es uno de los primeros intentos de un dispositivo donde el agente no es una app, sino la capa principal.

¿Por qué es relevante?

Porque adelanta el siguiente paso de la era post‑app: dispositivos pensados para colaboración continua entre humano + IA.

⚡ Bits Express

Trump cuestiona la compra de Warner Bros. por Netflix: dice que el acuerdo “podría ser un problema” y que piensa involucrarse personalmente en el proceso regulatorio, mientras el posible gigante del streaming encendería las alarmas antimonopolio en USA.

Google prepara Nano Banana 2 Flash: referencias internas apuntan a un nuevo modelo de la familia Gemini que promete calidad cercana a Pro pero más barato, pensado para llevar imágenes avanzadas a más usuarios y casos de uso masivos.

Titans: la nueva apuesta de Google para memoria a largo plazo: una arquitectura que permite a los modelos “recordar” mientras generan, decidiendo qué guardar y qué olvidar en tiempo real, con resultados fuertes en tareas de contexto extremo.

Geoffrey Hinton dice que Google está adelantando a OpenAI: el “padrino de la IA” apunta a Gemini 3, Nano Banana Pro y la estrategia de chips propios como señales de que Google podría marcar el ritmo de calidad, precios y seguridad.

Claude Code llega a Slack: Anthropic lanzó una beta que permite delegar tareas de código directamente desde canales de Slack, usando el contexto de las conversaciones y devolviendo PRs listos para revisar sin salir del chat.

🎓 Novedades en la Academia

La Academia es el lugar donde aprendes IA sin complicarte la vida. Todo está diseñado para que puedas usar la tecnología en tu trabajo real, sin necesitar conocimientos técnicos, sin horas de teoría y sin sentir que tienes que “volverte programador” para aprovecharla.

Aquí aprendes con lecciones cortas, directas y aplicables, que te muestran paso a paso cómo automatizar procesos, crear asistentes, mejorar tu flujo de trabajo y optimizar tareas que hoy te quitan tiempo. Son cursos pensados para emprendedores, freelancers y equipos dentro de empresas que necesitan resultados, no complicaciones.

Y como estamos cerrando el año fuerte, esta semana tenemos un descuento navideño especial para que entres, explores y empieces a preparar desde ya un 2026 con sistemas funcionando y menos carga operativa en tu día a día.

Esta semana vimos publicidad hecha con IA, lentes que cambian el juego, datos que revelan cómo estamos usando esta tecnología y un teléfono que reimagina la interacción con agentes.

Mantente cerca, mañana seguimos conectando señales. 😎