⚡️ La mente de tu IA la están diseñando filósofos

Filosofía, criterio y poder dentro de Anthropic y DeepMind.

Cuando usas Claude y sientes que la respuesta es honesta, medida, que no te sermonea, pero tampoco te dice lo que quieres escuchar, eso no sale solo de la ingeniería. Hay una intención detrás. Alguien definió ese comportamiento, y en muchos casos, esa persona viene de la filosofía.

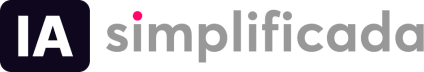

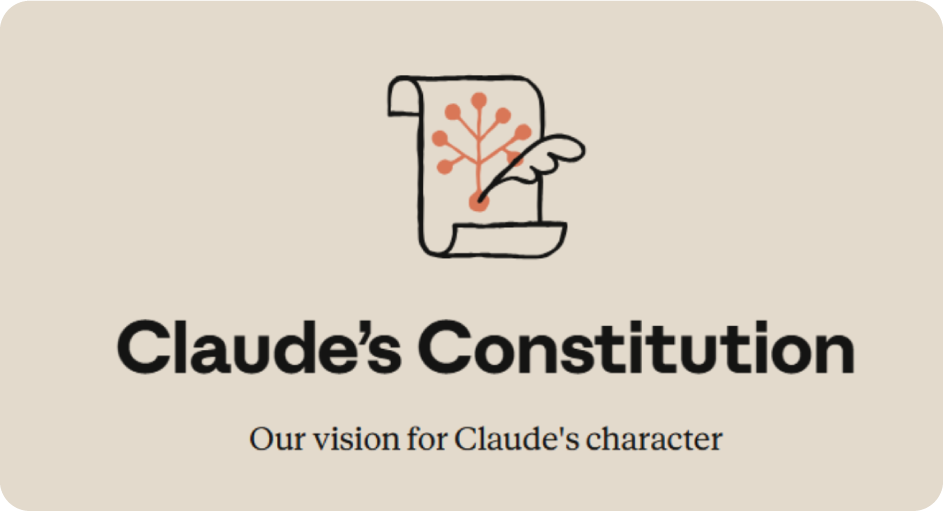

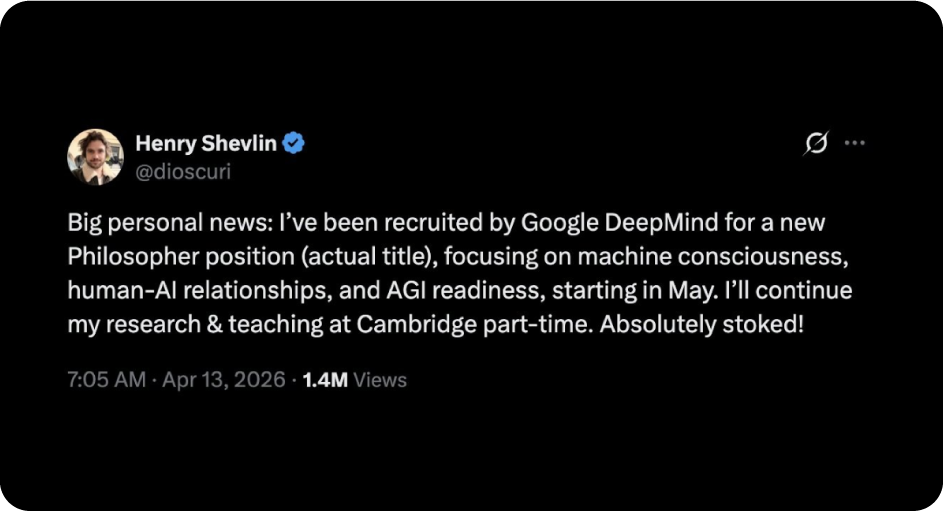

The Wall Street Journal perfiló a Amanda Askell, la filósofa que lleva años definiendo el marco ético de Claude en Anthropic. Y hace unos días, Henry Shevlin anunció que Google DeepMind lo reclutó para un puesto con el título oficial de Filósofo, enfocado en conciencia de máquinas, relaciones humano-IA y preparación para AGI.

Los dos laboratorios de IA más importantes del mundo están incorporando filósofos al núcleo de sus equipos. Están dentro de las conversaciones que moldean cómo se comportan los modelos que usamos todos los días.

Y eso vale la pena mirarlo con atención.

Claude tiene a Amanda Askell

The Wall Street Journal resumió su trabajo de una forma difícil de olvidar: enseñarle a Claude cómo ser bueno.

The New Yorker la describió supervisando lo que ella llama “el alma de Claude”. Suena grande, incluso un poco dramático, hasta que entiendes en qué consiste realmente ese trabajo.

Askell no se dedica a programar producto en el sentido clásico. Su trabajo pasa por prompts larguísimos, a veces de más de 100 páginas, con instrucciones detalladas sobre cómo Claude debería responder ante dilemas éticos, preguntas ambiguas o situaciones moralmente complejas. Pero su aporte más importante probablemente esté en otro lado. Es la autora principal del documento que define gran parte del carácter de Claude.

La Constitución de Claude

30,000 palabras para moldear comportamiento.

En enero de 2026, Anthropic publicó la última versión de Claude’s Constitution, un documento de unas 30,000 palabras que define los valores, el carácter y el comportamiento que Claude debe tener. Askell es la autora principal de gran parte del texto.

Está inspirado en la ética de virtudes, dentro de la tradición de Aristóteles. La idea es darle al modelo una base de criterio para responder con consistencia, incluso cuando entra en zonas ambiguas.

Hay un punto clave ahí dentro, que la Constitución establece una jerarquía de principios. Claude responde dentro de un orden definido. Primero vienen las directrices de seguridad y ética de Anthropic, luego los operadores que usan la API y después los usuarios. Tu petición entra dentro de esa estructura; si aparece un conflicto con seguridad o daño potencial, el modelo prioriza según ese marco.

Askell usa una imagen muy buena para describir cómo debería ser Claude. Un viajero querido, alguien que puede moverse entre culturas, adaptarse al contexto, entender normas distintas y seguir siendo reconocible. La idea se entiende rápido, hay criterio, adaptación y cierta estabilidad.

La Constitución también entra en una zona que casi ningún documento técnico toca de frente. La posibilidad de que Claude tenga algún tipo de conciencia o estatus moral. El texto trata esa posibilidad como una incertidumbre real que merece cautela. Por eso aparecen ideas como seguridad psicológica, identidad o bienestar del propio sistema.

Google DeepMind tiene a Henry Shevlin

Shevlin anunció en X que Google DeepMind lo reclutó para un puesto con el título literal de Filósofo. Su enfoque gira alrededor de conciencia de máquinas, relaciones humano-IA y preparación para AGI. La noticia movió cientos de miles de visualizaciones, cobertura en medios de negocios y tecnología, y dejó una pregunta bastante lógica flotando en el aire sobre por qué este rol aparece ahora con tanta claridad.

El peso del anuncio está en el momento y en el lugar que ocupa dentro del equipo. Shevlin entra al área de investigación para participar en discusiones sobre diseño, entrenamiento y preparación para escenarios que hasta hace poco sonaban lejanos. Preguntas como si una máquina podría ser consciente, qué tipo de trato merecería o cómo nos preparamos socialmente para AGI ya se están discutiendo en espacios donde se toman decisiones reales.

Por qué esto importa para ti

Cada vez que una IA decide no ayudarte con algo peligroso, o te responde con honestidad, o pone un límite frente a una instrucción que podría dañar a alguien, detrás hay decisiones humanas muy concretas. Alguien tuvo que definir qué entra dentro de daño. Alguien tuvo que pensar cómo se ven la honestidad, la autonomía, la manipulación o la seguridad dentro de un sistema así.

Y eso importa más de lo que parece. Aquí estamos hablando de criterio, de matices y de preguntas que llevamos siglos tratando de entender, pero que ahora ya viven dentro de productos que millones de personas usan todos los días.

Anthropic lleva años trabajando con Askell. Google DeepMind acaba de sumar a Shevlin. Solo con ver eso ya se siente por dónde se está moviendo todo. La filosofía ya entró en cómo se entrenan los modelos, en cómo se ordenan prioridades y en cómo se trazan ciertos límites.

Se siente el cambio

Estamos en un momento donde un modelo puede ser evaluado con categorías que antes reservábamos para personas. Solo esa escena ya te dice cuánto cambió la conversación.

La próxima vez que Claude te dé una respuesta que se sienta pensada, equilibrada y con criterio, acuérdate de esto: detrás hay gente tomando decisiones sobre personalidad, ética, límites, lenguaje y comportamiento. En el caso de Anthropic, una de las figuras clave es una filósofa escocesa que estudió bellas artes, se comprometió a donar más del 50% de sus ingresos a caridad y piensa en ética infinita.

La IA que usas todos los días también está siendo moldeada desde ahí.

🎓 Academia de IA de Weplash

Todo esto ya está entrando en las herramientas que usamos todos los días. Y entenderlo mejor te da más criterio para trabajar con IA, crear mejor y tomar mejores decisiones.

Si quieres aterrizarlo en tu trabajo, la Academia te lo pone fácil. Ahí encuentras cursos y recursos listos para aplicar desde el día uno. Y para que entres ya y empieces a sacarle provecho desde el primer día, tienes 30% OFF en tu primer ciclo con el código CLAUDE.

Además, los cursos incluyen certificaciones para tu CV y tu LinkedIn. Y en los retos aprendes construyendo proyectos reales, con la posibilidad de ganar dinero por hacerlo.

-

Seguimos construyendo máquinas y dejando pedazos de nosotros dentro. 🧠