⚡ La IA empezó a programarse sola - IA simplificada

Agentes que aguantan días, traducción que ya es capa base y plataformas aprendiendo a cobrarle a la IA.

Esta semana la IA dio varias señales claras de hacia dónde va todo esto. Agentes que ya construyen productos completos solos, traducción que deja de notarse porque está en todas partes y una pelea cada vez más intensa por controlar cómo fluye el conocimiento. Pero vamos por parte.

Índice

La IA que se construye a sí misma.

Traducción entra en su fase invisible.

ChatGPT ahora recuerda tu pasado.

La IA que se construye a sí misma

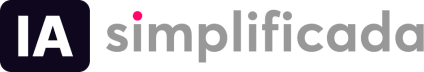

Cursor publicó un reporte mostrando que ejecutaron cientos de agentes de programación de forma autónoma durante semanas. Uno de esos “enjambres” construyó un navegador web funcional con 3 millones de líneas de código en menos de 7 días.

Para evitar caos, los agentes trabajaron con roles separados (planificadores, ejecutores y jueces). Con esa estructura también sacaron un emulador de Windows 7 y un clon de Excel, ambos con más de un millón de líneas de código.

Y el detalle jugoso, en tareas largas, GPT‑5.2 aguantó mejor que Claude Opus 4.5, que según el equipo tendía a tomar atajos cuando la ejecución se estiraba.

¿Por qué importa?

Porque se rompe la pared invisible que frenaba a los agentes, la resistencia en proyectos largos. El trabajo humano empieza a moverse de “escribir ladrillos” a dirigir y auditar enjambres.

La batalla de los traductores

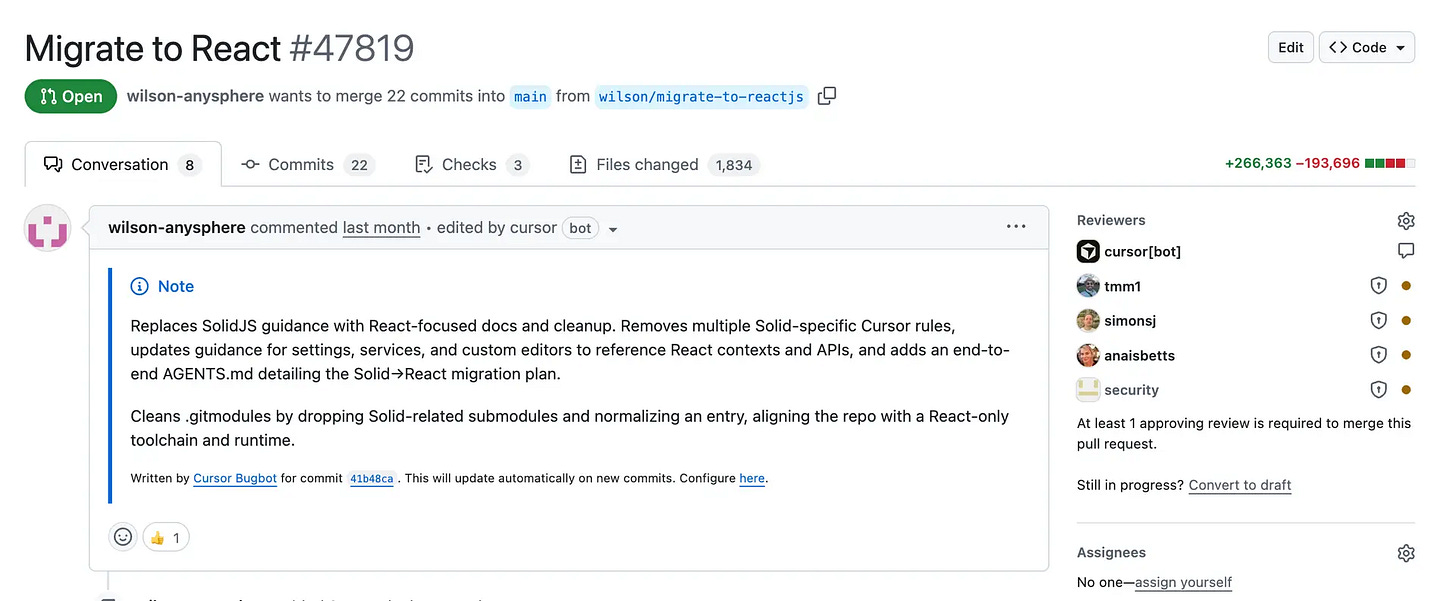

Primero OpenAI lanzó ChatGPT Translate, un traductor independiente pensado para competir directo con Google Translate, pero con foco en contexto, tono y adaptación al público.

Y casi sin dejar pasar el ruido, Google respondió con TranslateGemma, modelos abiertos de traducción (4B, 12B y 27B) que cubren 55 idiomas y pueden correr desde un teléfono hasta una GPU.

ChatGPT Translate no busca solo convertir texto de un idioma a otro. Su valor está en lo que viene después. Puedes ajustar intención, nivel de formalidad o audiencia y seguir trabajando el texto como parte de un flujo creativo. Google, en cambio, juega otra carta.

TranslateGemma está optimizado para eficiencia extrema.

El modelo mediano rinde mejor que versiones más grandes en benchmarks, y el pequeño iguala sistemas antiguos con una fracción del costo. Está destilado desde Gemini, pero pensado para integrarse en cualquier producto.

¿Por qué importa?

Porque la traducción deja de ser una app aislada y pasa a ser infraestructura invisible. OpenAI empuja la capa de intención y contexto; Google empuja escala, costo y ubicuidad. El ganador no será el que traduzca mejor una frase, sino el que logre que traducir sea algo que simplemente ocurre, en cualquier lugar, con el tono correcto.

ChatGPT ahora recuerda tu pasado

OpenAI activó una actualización grande de memoria para usuarios Plus y Pro. ChatGPT ahora puede recordar conversaciones de hace hasta un año y, lo más importante, llevarte directo al chat exacto donde ocurrió.

Antes, los chats eran casi desechables. Útiles en el momento, pero difíciles de recuperar. Con esta mejora, ChatGPT puede responder cosas como “¿qué me estabas preguntando hace un año?” y devolverte un resumen, con links directos a esas conversaciones.

Esto se apoya en la función Sources, que convierte el historial en algo navegable. De repente, recetas, análisis, ideas de trabajo o proyectos antiguos dejan de perderse.

¿Por qué importa?

Porque ChatGPT empieza a comportarse menos como un chat y más como una memoria de trabajo personal. Las conversaciones ya no son momentáneas, se vuelven acumulativas, reutilizables y conectadas en el tiempo.

No solo responde mejor hoy, sino que recuerda quién eras, qué estabas construyendo y por qué lo preguntaste. Y eso es un salto silencioso, pero enorme, en cómo usamos la IA a largo plazo.

⚡ Bits Express

OpenAI invierte en Merge Labs, el rival “sin cirugía” de Neuralink que usa ultrasonido y proteínas para interactuar con el cerebro. La apuesta señala que OpenAI empieza a mirar interfaces cerebro‑IA menos invasivas y más escalables que los implantes.

Wikipedia firma acuerdos pagos con Microsoft, Meta, Amazon, Perplexity y Mistral para acceso de datos a escala. Es un giro clave; el conocimiento abierto empieza a monetizarse formalmente frente al auge de modelos que lo usan como materia prima.

Digg vuelve en beta con verificación de humanos y moderación más transparente. El relanzamiento apunta a reconstruir comunidades reales en una web saturada de bots y contenido generado por IA.

OpenAI firma un deal de $10B+ con Cerebras para asegurar 750MW de cómputo hasta 2028. La carrera ya no es solo de modelos, sino de energía, chips y capacidad física para sostener la próxima ola de IA.

🎓 Novedades en la Academia

Esta semana activamos algo distinto dentro de la Academia.

Lanzamos un reto práctico para aprender a crear sitios web profesionales y funcionales usando IA, de esos que sí sirven para vender, sin saber código y sin vueltas técnicas.

La idea no es probar herramientas por probar, es salir con algo real. Una web que puedas usar para tu propio proyecto o para clientes.

Durante el reto vas a aprender a construir sitios completos con IA y vibe coding. Todos los participantes reciben certificado y los 3 mejores proyectos se llevan $500 cada uno.

📅 Empieza el 21 de enero.

El reto es exclusivo para miembros de la Academia. Si todavía no estás dentro, hay un descuento activo para entrar hoy y sumarte desde el día uno.

Nos estamos leyendo.