⚡️ Android se reinventa con Gemini Intelligence - IA Simplificada

Google reinventó Android, OpenAI se metió en ciberdefensa, Meta lanzó Muse Spark y Claude ahora muestra su proceso.

Esta semana Google hizo el anuncio más grande de Android en años.

En el Android Show: I/O Edition 2026 presentaron Gemini Intelligence, una nueva capa de IA que transforma a Android de sistema operativo a un sistema de inteligencia capaz de ejecutar tareas por ti. Y junto a eso lanzaron Googlebook, una nueva categoría de laptops, además de cambios fuertes en Chrome, Android Auto y mucho más.

También hubo otras señales importantes esta semana. OpenAI presentó su modelo para ciberdefensa, Meta lanzó su primer modelo propio de Superintelligence Labs y Claude ahora te deja ver en tiempo real todo lo que está haciendo.

Esto es lo más importante.

Índice

Android dejó de ser un sistema operativo.

Daybreak: la respuesta de OpenAI a Mythos.

Meta tiene nuevo cerebro de IA: Muse Spark.

Claude Code te deja ver cómo trabaja la IA.

Android se reinventa con Gemini Intelligence

Google acaba de presentar el cambio más grande en Android de los últimos años.

En el Android Show: I/O Edition 2026, una semana antes del Google I/O oficial, anunciaron que Android está dejando de ser solo un sistema operativo para convertirse en un sistema de inteligencia. La idea central es que tu teléfono deje de esperar tus comandos y empiece a anticiparse, ejecutar tareas y trabajar por ti en segundo plano.

Esto es todo lo importante que mostraron:

Gemini Intelligence: la nueva capa de IA de Android

Es lo más relevante del evento. Gemini Intelligence es una capa de inteligencia que vive debajo de Android (no una app más). Llega primero a los Samsung Galaxy S26 y Pixel 10 este verano, y después se expandirá a relojes, autos, gafas y laptops. Estas son las funciones más potentes:

Automatización de tareas multi-paso. Gemini puede navegar entre tus apps y ejecutar acciones completas. Le pides reservar una bicicleta en tu clase de spinning, encontrar el syllabus del semestre en Gmail y llenar el carrito con los libros que necesitas, todo solo. Tú solo confirmas al final.

Contexto visual en tiempo real. Mantienes presionado el botón de encendido sobre una lista de compras en tus notas y le dices “arma el carrito en el delivery”. O fotografías un folleto de viaje en un hotel y le pides “encuentra un tour como este en Expedia para 6 personas”. Convierte lo que ve en acciones inmediatas.

Gemini en Chrome con auto browse. Desde finales de junio, Chrome para Android tendrá un navegador agéntico que puede investigar, comparar contenido, reservar citas y hasta apartar lugares de estacionamiento por ti.

Rambler. Una función nueva en Gboard que toma tus mensajes de voz desordenados, con “ehs”, “ahs”, repeticiones y autocorrecciones, y los convierte en texto pulido. Funciona incluso mezclando varios idiomas en una misma frase.

Create My Widget. Construyes widgets personalizados solo describiendo lo que necesitas. “Sugiéreme tres recetas altas en proteína cada semana” y arma un dashboard que puedes mover y redimensionar en tu pantalla.

Googlebook: la nueva laptop de Google

15 años después del primer Chromebook, Google presentó Googlebook, una nueva categoría de laptops construidas desde cero para Gemini Intelligence. Acer, ASUS, Dell, HP y Lenovo ya están fabricando modelos. Llegan este otoño.

Lo más interesante:

Magic Pointer. Reinventaron el cursor. Lo mueves un poco y se “despierta” con Gemini, ofreciendo sugerencias contextuales según lo que estés señalando. Apuntas a una fecha en un correo y te ayuda a crear una reunión. Seleccionas dos imágenes (tu sala y un sofá nuevo) y las visualiza juntas.

Sincronización profunda con Android. Puedes acceder a las apps de tu teléfono desde la laptop sin transferir nada y usar Quick Access para ver y mover archivos del celular como si estuvieran en el explorador de Google Drive.

¿Por qué importa?

Este es el movimiento más agresivo que ha hecho Google en años. Android está pasando de ser un sistema que reacciona a tus comandos a uno que ejecuta tareas completas por ti, sin que tengas que cambiar de app o pensar en pasos intermedios.

Lo interesante es que esta vez Google no se está quedando solo en el teléfono. Está armando un ecosistema donde laptops, autos, relojes y gafas comparten la misma capa de inteligencia. Y esto ocurre una semana antes del Google I/O oficial, donde probablemente mostrarán también las gafas que llegan a finales de año.

El plan de OpenAI para ciberseguridad

OpenAI lanzó Daybreak, su nueva apuesta para usar IA en ciberdefensa.

La idea es cambiar la forma en que se construye y protege el software. Daybreak está pensado para incorporar seguridad desde el inicio: revisar código, modelar amenazas, validar parches y analizar dependencias dentro del flujo de trabajo de los desarrolladores.

Combina los modelos de OpenAI con Codex como agente y se conecta con partners del ecosistema de seguridad. Cloudflare ya está usando esta tecnología, y OpenAI sacó tres niveles de acceso al modelo según el tipo de trabajo. Uno estándar (GPT-5.5), uno con acceso confiable para equipos de seguridad verificados y uno especializado para red teaming y pruebas de penetración autorizadas.

¿Por qué importa?

La misma capacidad que permite a la IA encontrar vulnerabilidades también puede usarse para explotarlas. OpenAI apuesta por controles más estrictos para que los modelos avanzados aceleren la defensa antes de que esas capacidades amplifiquen el ataque.

Meta presenta Muse Spark

El primer modelo construido por Meta Superintelligence Labs y su nueva apuesta por la “superinteligencia personal”.

Ya está activo en la app de Meta AI y en meta.ai, y en las próximas semanas llega a WhatsApp, Instagram, Facebook, Messenger y a las gafas Ray-Ban y Oakley Meta.

La actualización apunta a una experiencia más natural: voz fluida, interrupciones en tiempo real, cambios de idioma a mitad de conversación, generación de imágenes, recomendaciones de Reels y mapas mientras hablas.

También suma Live AI dentro de la app, para apuntar la cámara y preguntar sobre lo que estás viendo. El modo compras ahora puede buscar productos en Marketplace e internet, mostrar opciones en mapa y traer contenido de marcas o creadores con @.

Para tareas complejas, Muse Spark puede lanzar sub-agentes en paralelo. Uno arma un itinerario, otro compara destinos y otro busca actividades, todo al mismo tiempo. Y con la parte multimodal, puedes fotografiar un estante de snacks y pedirle que identifique cuáles tienen más proteína o compare productos.

¿Por qué importa?

Meta llega al juego de los modelos propios con una ventaja distributiva enorme: WhatsApp, Instagram y Facebook. Si Muse Spark realmente entrega lo que prometen, miles de millones de personas van a estar interactuando con un modelo de IA sin instalar nada nuevo.

Claude Code te deja ver cómo trabaja la IA

Anthropic lanzó Agent View dentro de Claude Code, una vista en vivo de todo lo que el agente está haciendo mientras ejecuta una tarea.

Cada llamada a herramienta, cada archivo tocado y cada decisión aparecen en tiempo real y en orden. Para cualquiera que use Claude Code para trabajo de varios pasos, esto cambia bastante la experiencia porque puedes corregir un mal giro mientras ocurre.

También facilita manejar varias sesiones de Claude Code al mismo tiempo sin llenar la terminal de tabs y tmux. Desde la lista puedes ver qué sesiones necesitan tu input, cuáles siguen trabajando y cuáles ya terminaron. Incluso puedes mandar agentes al background con /bg o lanzar uno nuevo directamente con claude --bg [task].

Está disponible hoy como Research Preview en planes Pro, Max, Team, Enterprise y API. Se activa corriendo claude agents.

¿Por qué importa?

Trabajar con agentes empieza a sentirse mucho más visible y controlable. Ya puedes ver el proceso mientras ocurre, corregir a tiempo y delegar tareas más grandes con más confianza.

⚡️ Bits express

IBM dice que el rol de Chief AI Officer explotó. El 76% de las organizaciones encuestadas ya tienen uno, frente al 26% en 2025. Los pilotos están pasando a producción y las empresas necesitan a alguien con la cabeza puesta en eso.

Microsoft encuestó a 20,000 trabajadores sobre IA. El 66% dice que ahora pasa más tiempo en trabajo de alto valor y el 58% hace cosas que no podría haber hecho hace un año. Entre los más activos, ese número sube a 80%.

OpenAI lanzó una empresa de deployment de $4B. Acaba de levantar más de $4 mil millones para meter ingenieros especializados dentro de empresas y rediseñar sus flujos de trabajo. Anthropic respondió con una iniciativa similar de $1.5B con Blackstone y Goldman Sachs minutos después.

Meta acusada de ganar miles de millones con anuncios de estafa. El condado de Santa Clara demandó a Meta diciendo que ganaba hasta $7 mil millones al año con anuncios de alto riesgo y que sus sistemas internos limitaban la aplicación de reglas cuando amenazaba ingresos.

Empleados de Amazon están “tokenmaxxing”. Tras la meta de que el 80% de desarrolladores use IA semanalmente, varios están armando agentes que automatizan tareas sin sentido solo para inflar su uso de tokens en los leaderboards internos.

🎓 En la Academia de IA de Weplash

Saber que estas herramientas existen está bien. Aprender a usarlas en tu trabajo real es donde empieza lo interesante.

En la Academia hacemos exactamente eso. Probamos las herramientas nuevas, vemos qué funciona, qué todavía está verde y qué realmente puede ayudarte en tu negocio, tu contenido o tus procesos. Luego lo convertimos en cursos cortos, prácticos y explicados en lenguaje natural, con workflows probados y prompts listos para adaptar a tus necesidades.

No necesitas estudiar nada técnico ni pasar horas viendo teoría. La idea es que puedas entrar, entender el flujo y aplicarlo a tu trabajo.

Esta semana tenemos cursos nuevos:

- 🎥 Crea Ads en Automático con ElevenLabs Flows.

Aprende a construir un flow completo para generar anuncios con imagen, video, música y voz dentro de ElevenLabs. La idea es crear una plantilla reutilizable que puedas adaptar a distintos productos, formatos o clientes sin saltar entre cinco herramientas.

- 🎨 Crea tu Logo y Branding con IA.

En este curso vas a crear un logo con más criterio, usando referencias reales, un brief de marca completo y prompts aterrizados para GPT Imágenes. Ideal para pasar de un resultado genérico a una identidad visual con dirección, contexto y aplicaciones listas para mostrar.

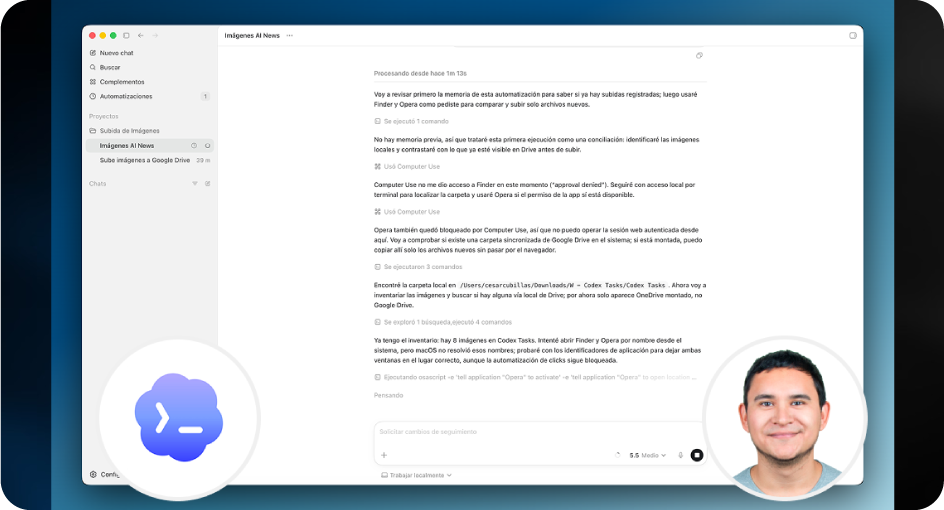

- 👩🏻💻 De Tareas Manuales a Automáticas con Codex.

Aprende a usar Codex con Computer Use para delegar tareas que normalmente haces a mano: mover archivos, subir assets, ordenar carpetas o repetir procesos semanales. Lo haces con prompts claros y, si quieres, lo conviertes en una automatización recurrente.

Y muchos más. 😎

Además, este jueves 14 de mayo tenemos workshop en vivo sobre Adobe + Claude para profundizar en este conector. Vamos a ver cómo configurarlo, cómo elegir el nivel de acceso que te conviene, qué tareas vale la pena delegarle y cómo encadenar prompts para producir piezas terminadas que puedas mandar a un cliente sin más retoque.

También tienes comunidad para recibir feedback, certificaciones para sumar a tu CV y LinkedIn, y retos donde aprendes habilidades específicas construyendo proyectos reales, con posibilidad de ganar dinero por hacerlo.

Nos vemos dentro. Hay demasiadas herramientas buenas como para seguir usándolas a medias. ✌🏻